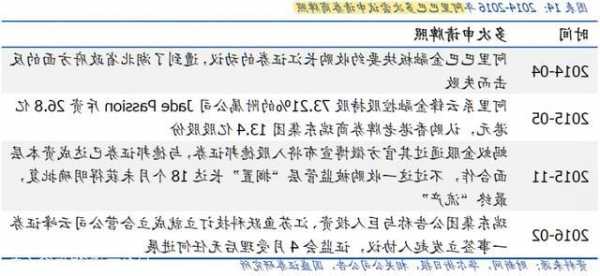

GPT-4V 学会用键鼠上网,人类眼睁睁看着它发帖玩游戏

GPT-4V 学会自动操纵电脑,这一天终于还是到来了。

只需要给 GPT-4V 接入鼠标和键盘,它就能根据浏览器界面上网:

甚至还能快速摸清楚“播放音乐”的播放器网站和按钮,给自己来一段 music:

是不是有点细思极恐了?

这是一个 MIT 本科生小哥整出来的新活,名叫 GPT-4V-Act。

只需要几个简单的工具,GPT-4V 就能学会控制你的键盘和鼠标,用浏览器上网发帖、买东西甚至是玩游戏。

要是用到的工具出 bug 了,GPT-4V 甚至还能意识到、并试图解决它。

来看看这是怎么做到的。

GPT-4V-Act,本质上是一个基于 Web 浏览器的 AI 多模态助手(Chromium Copilot)。

它可以像人类一样用鼠标、键盘和屏幕“查看”网页界面,并通过网页中的交互按键进行下一步操作。

要实现这种效果,除了 GPT-4V 以外,还用到了三个工具。

一个是 UI 界面,可以让 GPT-4V“看见”网页截图,也能让用户与 GPT-4V 发生交互。

这样,GPT-4V 就能将每一步运行思路都通过对话框的形式反映出来,用户来决定是否要继续让它操作。

另一个是 Set-of-Mark Prompting(SoM)工具,让 GPT-4V 学会交互的一款工具。

这个工具由微软发明,目的是更好地对 GPT-4V 进行提示词工程。

相比让 GPT-4V 直接“看图说话”,这个工具可以将图片关键细节拆分成不同的部分,并进行编号,让 GPT-4V 有的放矢:

对于网页端也是如此,Set-of-Mark Prompting 用类似的方式让 GPT-4V 知道从网页浏览器的哪个部分找答案,并进行交互。

最后,还需要用到一个自动标注器(JS DOM auto-labeler),可以将网页端所有能交互的按键标注出来,让 GPT-4V 决定要按哪个。

一套流程下来,GPT-4V 不仅能准确判断图片上的哪些内容符合需求,还能准确找到交互按键,并学会“自动上网”。

这是个大项目,目前还只实现了部分功能,包括点击、打字交互、自动标注等。

接下来,还有其他的一些功能要实现,例如试试 AI 打标器(目前网页端的交互还是通过通过 JS 接口得知哪里能交互,不是 AI 识别的)、以及提示用户输入详细信息等。

此外,作者也提到,现阶段 GPT-4V-Act 用法上还有一些需要注意的地方。

例如,GPT-4V-Act 可能会被网页打开后铺天盖地的弹窗小广告给“整懵了”,然后出现交互 bug。

又例如,目前这种玩法可能会违反 OpenAI 的产品使用规定:

所以用的时候也要低调一点(doge)

这个项目在网上发出后,吸引了不少人的围观。

像是小哥用到的微软 Set-of-Mark Prompting 工具的作者,就发现了这个项目:

还有网友提到,甚至可以用来让 AI 自己读取验证码。

这个在 SoM 项目中提到过,GPT-4V 是能成功解读验证码的(所以以后可能还真不知道是人还是机器在上网

)。

与此同时,也有网友已经在想象桌面流自动化(desktop automation)的操作了。

对此作者回应称:

不过目前 GPT-4V 还是要收费的,有没有其他的实现方法?

作者也表示,目前还没有,但确实可能会尝试 Fuyu-8B 或者 LLAR 这样的开源模型。

免费的自动化桌面流 AI 助手,可以期待一波了。

参考链接:

本文来自微信公众号:量子位 (ID:QbitAI),作者:萧箫

广告声明:文内含有的对外跳转链接(包括不限于超链接、二维码、口令等形式),用于传递更多信息,节省甄选时间,结果仅供参考,IT之家所有文章均包含本声明。

作者:xinfeng335本文地址:https://www.szsjgsy.com/post/2165.html发布于 今天

文章转载或复制请以超链接形式并注明出处义乌市挈宇网络科技有限公司